AI 歷史Timeline

本篇報告由AI生成,但經查證多數為真

開始嘗試大量用AI研究公司,也順便透過AI整理了AI歷史,分享給大家

AI 重大里程碑:編年史回顧 (著重人、事、物及其影響)

1. 奠基期 (1940s - 1950s):理論的萌芽

人物/時間/貢獻:

Alan Turing (艾倫·圖靈) - 1950年 - 發表論文《Computing Machinery and Intelligence》(計算機器與智能)。

貢獻詳述: 提出了著名的「圖靈測試」(Turing Test) 作為判斷機器是否能展現與人無法區分的智能行為的標準。他探討了機器思考的可能性,奠定了AI的哲學基礎。

原理/應用概念: 模擬人類對話、智能的定義。雖然圖靈測試本身有爭議,但它激發了後續對機器智能的思考與研究方向。

後續影響: 成為 AI 領域的經典思想實驗,持續引發關於「智能」本質的討論。為後來的自然語言處理、對話系統等研究提供了最初的願景。

人物/時間/貢獻:

John McCarthy (約翰·麥卡錫), Marvin Minsky (馬文·閔斯基), Nathaniel Rochester (納撒尼爾·羅徹斯特), Claude Shannon (克勞德·香農) 等 - 1956年 - 舉辦「達特茅斯會議」(Dartmouth Workshop)。

貢獻詳述: 正式確立了「人工智能 (Artificial Intelligence)」這一術語,並聚集了當時對此領域感興趣的頂尖科學家。會議設定了 AI 的核心目標:讓機器能夠模擬人類學習和其他智能的各個方面。

原理/應用概念: 符號主義 AI (Symbolic AI) 的開端,認為智能的核心是符號的處理與邏輯推理。

後續影響: 標誌著 AI 作為一個獨立研究領域的誕生,確立了早期研究方向(如推理、搜索、問題求解),並凝聚了第一代 AI 研究者社群。

人物/時間/貢獻:

Allen Newell (艾倫·紐厄爾), Herbert A. Simon (赫伯特·西蒙), J.C. Shaw (肖) - 1956年 - 開發「邏輯理論家」(Logic Theorist)。

貢獻詳述: 被廣泛認為是第一個 AI 程序。它能夠模擬人類的邏輯推理過程,證明了《數學原理》中的一些定理。

原理/應用概念: 啟發式搜索 (Heuristic Search)、符號邏輯、問題求解。展示了機器進行符號操縱和推理的能力。

後續影響: 證明了 AI 的可行性,啟發了後續的通用問題求解器 (General Problem Solver, GPS) 等研究,是早期符號主義 AI 的重要成果。

人物/時間/貢獻:

Frank Rosenblatt (弗蘭克·羅森布拉特) - 1957-1958年 - 發明「感知器」(Perceptron)。

貢獻詳述: 最早的人工神經網絡模型之一,是一種單層神經網絡,可以學習對輸入模式進行分類(如識別簡單圖像)。

原理/應用概念: 連接主義 (Connectionism) 的早期思想、監督式學習、模式識別。模擬生物神經元的學習機制。

後續影響: 開啟了神經網絡研究的大門。雖然其局限性(無法解決線性不可分問題,如 XOR)後來被指出,但為後來的多層神經網絡和深度學習奠定了基礎。

人物/時間/貢獻:

John McCarthy (約翰·麥卡錫) - 1958年 - 發明 LISP 語言。

貢獻詳述: 設計了一種專門用於 AI 研究的高級程式語言 (LISt Processing)。它擅長符號處理、遞迴和列表操作。

原理/應用概念: 符號計算、函數式編程。為 AI 算法的實現提供了強大的工具。

後續影響: 成為 AI 領域數十年的標準程式語言,影響深遠,許多 AI 概念和技術都借助 LISP 得以實現和發展。

2. 發展與起伏期 (1960s - 1980s):期望與現實

人物/時間/貢獻:

研究界 (如 Edward Feigenbaum, Bruce Buchanan, Edward Shortliffe 等) - 1970s - 1980s - 「專家系統」(Expert Systems) 的興起。

貢獻詳述: 開發出能在特定狹窄領域模擬人類專家決策能力的系統,如 MYCIN (醫學診斷)、DENDRAL (化學分析)。這些系統基於大量的「IF-THEN」規則和知識庫。

原理/應用概念: 知識工程、規則庫、推理機。將人類專家的知識編碼成計算機能理解和執行的形式。

後續影響: 首次展示了 AI 的商業價值和實際應用潛力,引發了投資熱潮。但也暴露了知識獲取的瓶頸、系統的脆弱性(處理不確定性和常識能力差)等問題。

事件: 第一次 AI 寒冬 (約 1974-1980)

原因: 過高期望未能實現、計算能力限制、對早期方法(如感知器)局限性的批評(Minsky & Papert 的書)、研究經費削減(如英國 Lighthill 報告)。

影響: 研究熱情和資助下降,研究方向開始反思和調整。

人物/時間/貢獻:

David Rumelhart, Geoffrey Hinton, Ronald Williams 等 - 1986年 - 普及「反向傳播算法」(Backpropagation)。

貢獻詳述: 提出或重新發現並推廣了一種能有效訓練多層神經網絡的方法。該算法通過計算輸出層誤差,逐層反向傳播,來調整網絡各層的權重。

原理/應用概念: 梯度下降、鏈式法則、多層感知器 (MLP)、監督式學習。解決了早期單層感知器的局限性,讓訓練更深層次的網絡成為可能。

後續影響: 標誌著連接主義的復興,是後來深度學習發展的關鍵技術基礎。使得神經網絡能夠學習更複雜的模式。

事件: 第二次 AI 寒冬 (約 1987-1993)

原因: 專家系統熱潮的消退(成本高、維護難、效果有限)、LISP 機器市場的崩潰、計算能力仍相對有限。

影響: AI 研究再次面臨資金和信心的挑戰,促使研究者尋求更穩健、更基於數學和統計的方法。

3. 機器學習崛起與突破 (1990s - 2010s):數據驅動

人物/時間/貢獻:

Vladimir Vapnik, Corinna Cortes 等 - 1990s - 支持向量機 (SVM) 等統計學習方法的興起。

貢獻詳述: 發展了基於統計學習理論的機器學習算法,如 SVM。這些方法在分類和回歸任務上表現出色,尤其是在高維數據和小樣本情況下,具有良好的泛化能力。

原理/應用概念: 統計學習理論、最大間隔分類器、核技巧。強調模型的泛化能力和數學嚴謹性。

後續影響: 在深度學習興起前,SVM 等方法是許多機器學習任務的主流和最佳選擇,推動了機器學習作為一個獨立領域的發展。

人物/時間/貢獻:

IBM 團隊 - 1997年 - 深藍 (Deep Blue) 擊敗國際象棋世界冠軍 Garry Kasparov。

貢獻詳述: IBM 開發的超級計算機「深藍」在一場備受矚目的比賽中戰勝了當時的國際象棋世界冠軍。

原理/應用概念: 專用硬件、大規模並行計算、暴力搜索(結合優化的 Alpha-Beta 剪枝)、開局庫、殘局庫、評估函數。展示了計算能力和特定算法在複雜策略遊戲中的威力。

後續影響: 成為 AI 發展史上一個重要的公共里程碑,證明了機器在高度複雜的智力任務上可以超越人類頂尖水平,儘管其方法更多依賴計算而非「智能」。

人物/時間/貢獻:

Fei-Fei Li (李飛飛) 等 - 2009年 - 創建 ImageNet 數據集。

貢獻詳述: 建立了一個包含超過 1400 萬張標註圖像的大規模視覺數據庫,涵蓋 2 萬多個類別。並在此基礎上舉辦年度挑戰賽 (ILSVRC)。

原理/應用概念: 大規模數據集、基準測試。為訓練和評估複雜的視覺識別模型提供了基礎。

後續影響: 極大地推動了計算機視覺領域的發展,是深度學習革命的關鍵催化劑之一。沒有這樣的大數據,深度學習模型很難訓練出好的效果。

人物/時間/貢獻:

Alex Krizhevsky, Ilya Sutskever, Geoffrey Hinton - 2012年 - AlexNet 在 ImageNet 挑戰賽 (ILSVRC) 中取得突破性勝利。

貢獻詳述: 他們設計的深度卷積神經網絡 (CNN) AlexNet,在 ILSVRC 圖像分類任務上的準確率遠超之前的最佳方法(錯誤率從 26% 降至 15.3%)。

原理/應用概念: 深度學習 (Deep Learning)、卷積神經網絡 (CNN)、ReLU 激活函數、Dropout 正則化、GPU 加速計算。展示了深度架構在大數據和強大算力支持下的巨大潛力。

後續影響: 標誌著深度學習時代的正式開啟。引發了學術界和工業界對深度學習的廣泛關注和投入,迅速革新了計算機視覺,並隨後影響了自然語言處理、語音識別等眾多領域。

人物/時間/貢獻:

DeepMind (Google 旗下) - 2016年 - AlphaGo 擊敗世界圍棋冠軍 Lee Sedol (李世石)。

貢獻詳述: AlphaGo 結合了深度神經網絡和蒙特卡洛樹搜索 (MCTS),在圍棋這一被認為極其複雜、依賴直覺的策略遊戲中戰勝了人類頂尖棋手。

原理/應用概念: 深度強化學習 (Deep Reinforcement Learning)、蒙特卡洛樹搜索 (MCTS)、策略網絡 (Policy Network)、價值網絡 (Value Network)、自我對弈學習。展示了 AI 在解決更複雜、更接近人類直覺的決策問題上的能力。

後續影響: 再次震驚世界,證明了深度強化學習的強大能力,推動了其在遊戲 AI、機器人控制、優化問題等領域的應用研究。後續的 AlphaZero 更進一步,無需人類棋譜,通過自我對弈達到超人水平。

4. 大模型與生成式 AI 時代 (2017s - 至今):能力的湧現

人物/時間/貢獻:

Ashish Vaswani 等 (Google Brain/Research) - 2017年 - 發表論文《Attention Is All You Need》,提出 Transformer 模型。

貢獻詳述: 提出了一種完全基於自注意力機制 (Self-Attention) 的新型神經網絡架構 Transformer,摒棄了傳統 NLP 模型中常用的遞迴 (RNN) 或卷積 (CNN) 結構。

原理/應用概念: 自注意力機制、位置編碼、多頭注意力、編碼器-解碼器架構。能夠更好地捕捉序列中的長距離依賴關係,並且非常適合並行計算。

後續影響: 徹底改變了自然語言處理 (NLP) 領域。成為後續幾乎所有大型語言模型 (LLM) 的基礎架構,如 BERT、GPT 系列等,極大地提升了機器翻譯、文本生成、問答等任務的性能。

人物/時間/貢獻:

OpenAI, Google, Meta, Anthropic 等公司和研究機構 - 約 2018年至今 - 大型語言模型 (Large Language Models, LLMs) 和 生成式 AI (Generative AI) 的爆發。

貢獻詳述: 基於 Transformer 架構,訓練出參數規模巨大(數十億至數萬億)的模型,如 GPT 系列 (OpenAI)、BERT (Google)、LaMDA (Google)、LLaMA (Meta)、Claude (Anthropic) 等。這些模型在海量文本數據上進行預訓練,展現出驚人的語言理解和生成能力。同時,擴散模型 (Diffusion Models) 等技術的發展也推動了圖像生成(如 DALL-E 2, Stable Diffusion, Midjourney)等領域的突破。

原理/應用概念: Transformer 架構、大規模預訓練 (Pre-training)、自監督學習、微調 (Fine-tuning)、提示工程 (Prompt Engineering)、擴散模型。利用海量數據和算力學習通用的知識和能力,並能通過少量樣本或指令適應新任務。

後續影響: 將 AI 的能力推向了新的高度,使得 AI 能夠生成高質量的文本、圖像、代碼甚至音樂,極大地影響了內容創作、人機交互、信息獲取等方式。ChatGPT 的發布 (2022年底) 引發了全球範圍的關注和討論,標誌著生成式 AI 進入大眾視野,同時也帶來了關於倫理、偏見、就業、信息真實性等方面的深刻挑戰。

總結:

AI 的發展是一個充滿探索、突破、挫折和復興的過程。從早期的邏輯推理和符號處理,到連接主義的神經網絡,再到數據驅動的機器學習,直至今日由大數據、大算力和先進模型(如 Transformer)驅動的深度學習和大型生成式模型。每一個里程碑都建立在先前研究的基礎上,解決了某些舊問題,同時也可能帶來新的挑戰。理解這些關鍵節點、人物和技術原理,有助於我們更深入地把握 AI 的本質、潛力與未來走向。

希望這份整理對你的研究有所幫助!如果你想深入了解某個特定的里程碑或技術原理,我們可以繼續探討。

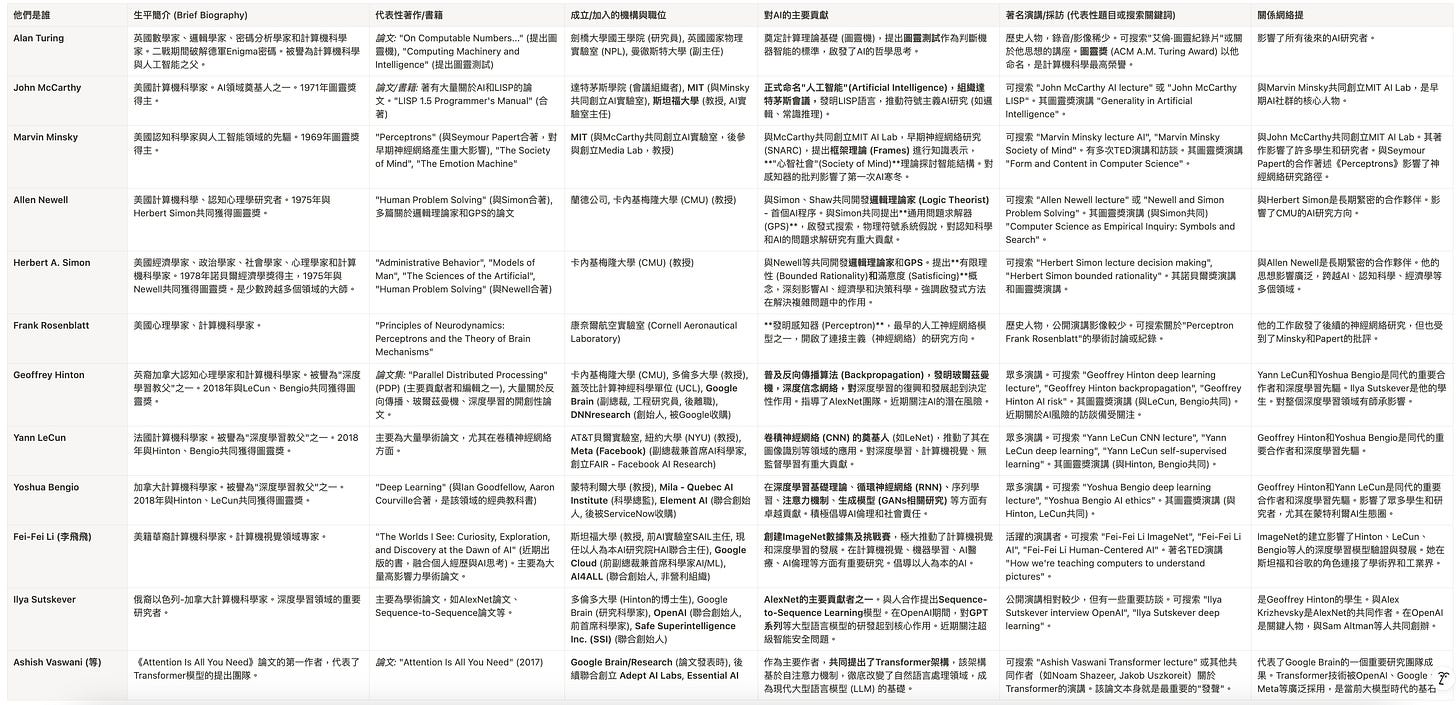

好的,這份表格旨在整理您之前研究中提到的AI領域關鍵人物,以及與他們相關的一些信息,幫助您建立對AI發展脈絡和人脈網絡的理解。請注意,由於信息龐雜且人物眾多,這裡會聚焦於影響力較大或代表了關鍵轉折點的人物,並盡可能提供您要求的資訊。對於書籍和演講,由於數量可能很多,會列舉代表性的或容易查找的。

AI 關鍵人物及其貢獻 (部分代表)

關於人脈網絡的提示:

師承關係: 如 Hinton 是 Sutskever 的導師。理解導師對學生的影響,以及學生如何在前人基礎上開拓。

合作關係: 如 Newell 和 Simon 長期合作;Hinton、LeCun、Bengio 在深度學習領域既有獨立貢獻也有相互影響和合作;Transformer 論文是團隊合作的成果。

機構聚集: 頂尖大學(MIT, Stanford, CMU, U Toronto)和大型科技公司(Google Brain/Research, Meta AI/FAIR, OpenAI)是人才聚集和思想碰撞的中心。了解誰在哪裡工作過,有助於理解技術流派和發展重點。

會議與社區: 達特茅斯會議是AI領域的開端。NeurIPS, ICML, ICLR 等頂級學術會議是研究者交流思想、發表成果、建立聯繫的重要場所。

傳承與影響: 早期奠基者(Turing, McCarthy, Minsky)的思想和工具(LISP)影響了數代人。深度學習三巨頭的工作直接催生了當前的AI浪潮。ImageNet為深度學習突破提供了燃料。Transformer為大模型鋪平了道路。

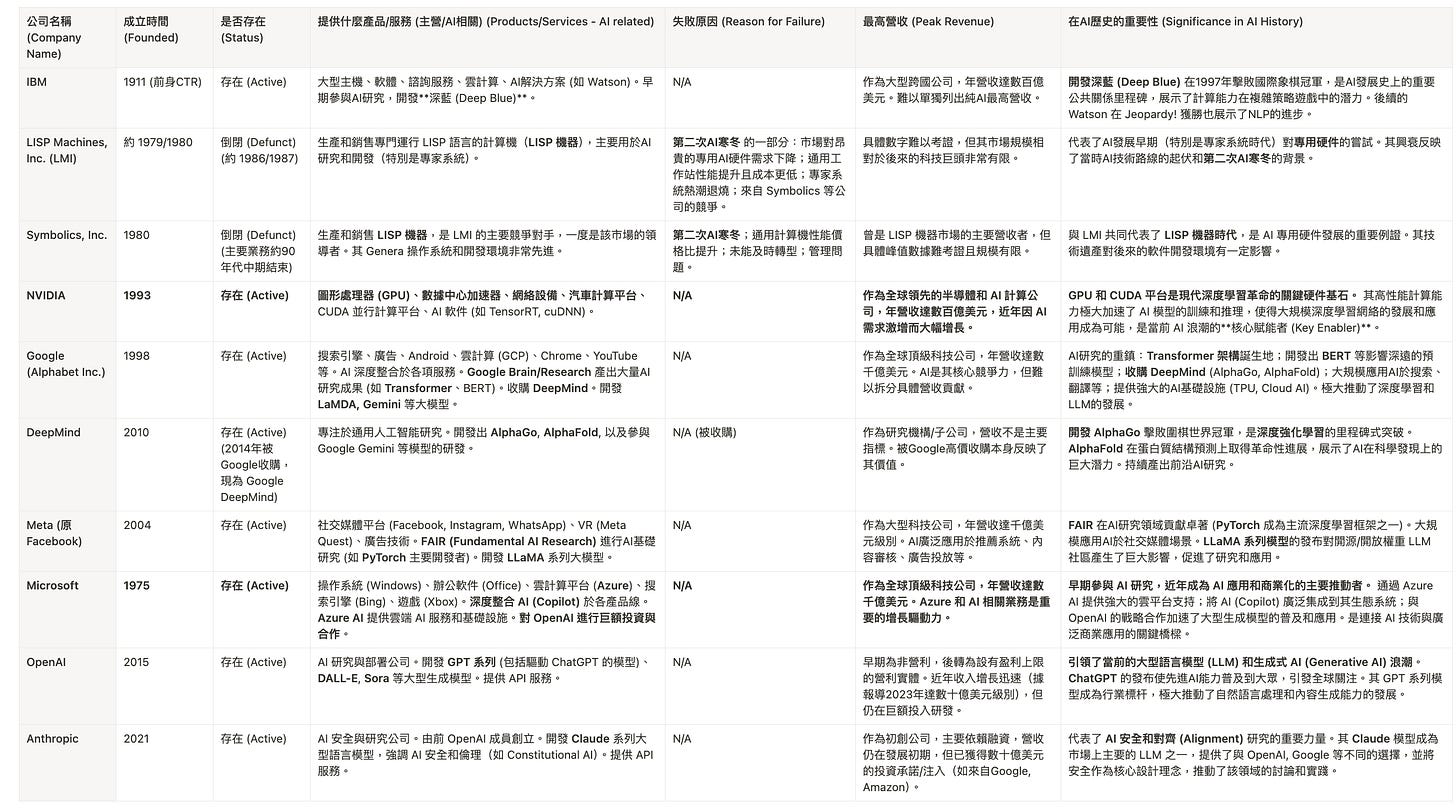

AI 重要里程碑相關公司及其貢獻